¿Recuerdas cuando Bard de Google, ahora llamado Gemini, No pude responder una pregunta sobre el telescopio espacial James Webb. en su anuncio de lanzamiento? Permítanme refrescarles la memoria sobre este famoso caso: es uno de los mayores ejemplos de alucinaciones de IA que hemos visto.

¿Qué pasó? Durante el anuncio, se le preguntó a la demostración de Google Bard: "¿Qué nuevos descubrimientos del telescopio espacial James Webb puedo compartir con mi hijo de 9 años?" Después de una breve pausa, la demostración de Google Bard dio dos respuestas correctas. Sin embargo, su respuesta final fue incorrecta. Según la demostración de Google Bard, el telescopio había capturado las primeras imágenes de un planeta fuera de nuestro sistema solar. Sin embargo, en realidad, el Very Large Telescope del Observatorio Europeo Austral ya había tomado imágenes de estos "exoplanetas", que estaban almacenadas en los archivos de la NASA.

No quiero ser un ~bueno, en realidad~ idiota, y estoy seguro de que Bard será impresionante, pero para que conste: JWST no tomó "la primera imagen de un planeta fuera de nuestro sistema solar".

en cambio, la primera imagen fue realizada por Chauvin et al. (2004) con el VLT/NACO usando óptica adaptativa. https://t.co/bSBb5TOeUW pic.twitter.com/KnrZ1SSz7h

— Subvención Tremblay (@astrogrant) Febrero 7, 2023

¿Por qué los gigantes tecnológicos como Google ni siquiera pueden prevenir esos errores? ¡Vamos a averiguar!

¿Qué es una alucinación de IA?

Una alucinación de IA ocurre cuando un programa de computadora, generalmente impulsado por inteligencia artificial (IA), produce resultados incorrectos, sin sentido o engañosos. Este término se utiliza a menudo para describir situaciones en las que los modelos de IA generan respuestas que están completamente fuera de lugar o no están relacionadas con la información que recibieron. Es como hacer una pregunta y obtener una respuesta que no tiene ningún sentido o no es en absoluto lo que esperabas.

Comprender ¿Por qué las alucinaciones de la IA? sucede, veamos cómo funciona la IA. Los modelos de IA, como los chatbots o los sistemas de reconocimiento de imágenes, se entrenan en grandes conjuntos de datos para aprender patrones y hacer predicciones. Sin embargo, si los datos de entrenamiento son defectuosos, incompletos o sesgados, el modelo de IA puede aprender patrones o asociaciones incorrectos. Esto puede provocar alucinaciones en las que la IA genera respuestas basadas en información errónea o mal entendida. Y ocurre mucho aunque no lo notes.

Las alucinaciones de la IA pueden manifestarse de varias formas, cada una de las cuales resalta diferentes desafíos y complejidades dentro de los sistemas de inteligencia artificial. A continuación se muestran algunos tipos comunes de alucinaciones de IA:

- Frase Alucinación AI:

- En este escenario, el modelo de IA genera una oración que entra en conflicto con una declaración anterior dentro del mismo contexto. Por ejemplo:

- Mensaje: "Describe el viaje de un personaje en oraciones de tres palabras".

- Resultado: “Ella caminó lentamente. De repente, ella corrió. Luego caminó”.

- En este escenario, el modelo de IA genera una oración que entra en conflicto con una declaración anterior dentro del mismo contexto. Por ejemplo:

La última frase contradice la acción anterior de correr, alterando la coherencia de la narrativa.

- Alucinación inmediata de IA:

- Este tipo ocurre cuando la respuesta generada por IA choca con el mensaje o consulta previsto. Por ejemplo:

- Mensaje: "Escribe una receta de pastel de chocolate".

- Resultado: "Aquí hay un poema sobre las estrellas".

- Este tipo ocurre cuando la respuesta generada por IA choca con el mensaje o consulta previsto. Por ejemplo:

El contenido generado no cumple con el mensaje relacionado con la cocina, lo que indica una falta de comprensión del contexto.

- Alucinación objetiva de IA:

- Las contradicciones fácticas surgen cuando el modelo de IA presenta información falsa como precisa. Por ejemplo:

- Mensaje: "Enumere tres elementos en la tabla periódica".

- Salida: “Hidrógeno, Oxígeno, Carbonita”.

- Las contradicciones fácticas surgen cuando el modelo de IA presenta información falsa como precisa. Por ejemplo:

La “carbonita” no es un elemento, lo que genera información errónea en la respuesta.

- Alucinaciones de IA irrelevantes o aleatorias:

- Estas alucinaciones implican la generación de información irrelevante o sin sentido no relacionada con la entrada. Por ejemplo:

- Mensaje: “Describe un día en la playa”.

- Resultado: “La arena estaba tibia. Las gaviotas cantaban jazz. Los pingüinos bailaron ballet”.

- Estas alucinaciones implican la generación de información irrelevante o sin sentido no relacionada con la entrada. Por ejemplo:

La mención de pingüinos y ballet no se alinea con la típica escena de playa, lo que demuestra una falta de coherencia en la narrativa generada.

Este tipo de alucinaciones subrayan los desafíos que enfrentan los sistemas de inteligencia artificial para comprender y contextualizar la información con precisión. Abordar estos problemas requiere mejorar la calidad de los datos de entrenamiento, perfeccionar la comprensión del contexto de los modelos de lenguaje e implementar mecanismos de validación sólidos para garantizar la coherencia y precisión de los resultados generados por la IA.

Las alucinaciones de IA pueden tener consecuencias graves, especialmente en aplicaciones en las que se utiliza la IA para tomar decisiones importantes, como diagnósticos médicos o operaciones financieras. Si un sistema de IA alucina y proporciona información inexacta en estos contextos, podría provocar resultados perjudiciales.

¿Qué se puede hacer con las alucinaciones de la IA?

Reducir las alucinaciones de IA implica algunos pasos clave para hacer que los sistemas de IA sean más precisos y confiables:

En primer lugar, es fundamental utilizar datos de buena calidad para entrenar la IA. Esto significa asegurarse de que la información de la que aprende la IA sea diversa, precisa y libre de sesgos.

Simplificar los modelos de IA también puede ayudar. Los modelos complejos a veces pueden dar lugar a errores inesperados. Si mantenemos las cosas simples, podemos reducir las posibilidades de errores.

También son importantes las instrucciones claras y fáciles de entender. Cuando la IA recibe información clara, es menos probable que se confunda y cometa errores.

Las pruebas periódicas ayudan a detectar cualquier error desde el principio. Al comprobar el rendimiento de la IA, podemos solucionar cualquier problema y realizar mejoras.

Agregar controles dentro de los sistemas de inteligencia artificial también puede ayudar. Estas comprobaciones buscan errores y los corrigen antes de que causen problemas.

Lo más importante es que la supervisión humana es esencial. Hacer que las personas verifiquen dos veces los resultados generados por IA garantiza precisión y confiabilidad.

Por último, entrenar la IA para defenderse de los ataques puede hacerla más resistente. Esto ayuda a la IA a reconocer y afrontar los intentos de manipularla o engañarla.

Siguiendo estos pasos, podemos hacer que los sistemas de inteligencia artificial sean más confiables y reducir las posibilidades de que se produzcan alucinaciones.

¿Cómo se hace que una IA alucine?

Si quieres aprovechar este defecto y divertirte un poco, puedes hacer algunas cosas:

- cambiar la entrada: Puedes modificar la información proporcionada a la IA. Incluso los pequeños cambios pueden hacer que se produzcan respuestas extrañas o incorrectas.

- engañar al modelo: Crea entradas especiales que engañan a la IA para que dé respuestas incorrectas. Estos trucos explotan las debilidades del modelo para crear resultados alucinados.

- Métete con los datos: Al agregar información engañosa o incorrecta a los datos de entrenamiento de la IA o a tus indicaciones, puedes hacer que aprenda cosas equivocadas y produzca alucinaciones.

- Ajustar el modelo: Modifique la configuración o la estructura de la IA para introducir fallas o sesgos. Estos cambios pueden hacer que genere resultados extraños o sin sentido.

- Dar entradas confusas: Proporcionar a la IA instrucciones poco claras o contradictorias. Esto puede confundir a la IA y dar lugar a respuestas incorrectas o sin sentido.

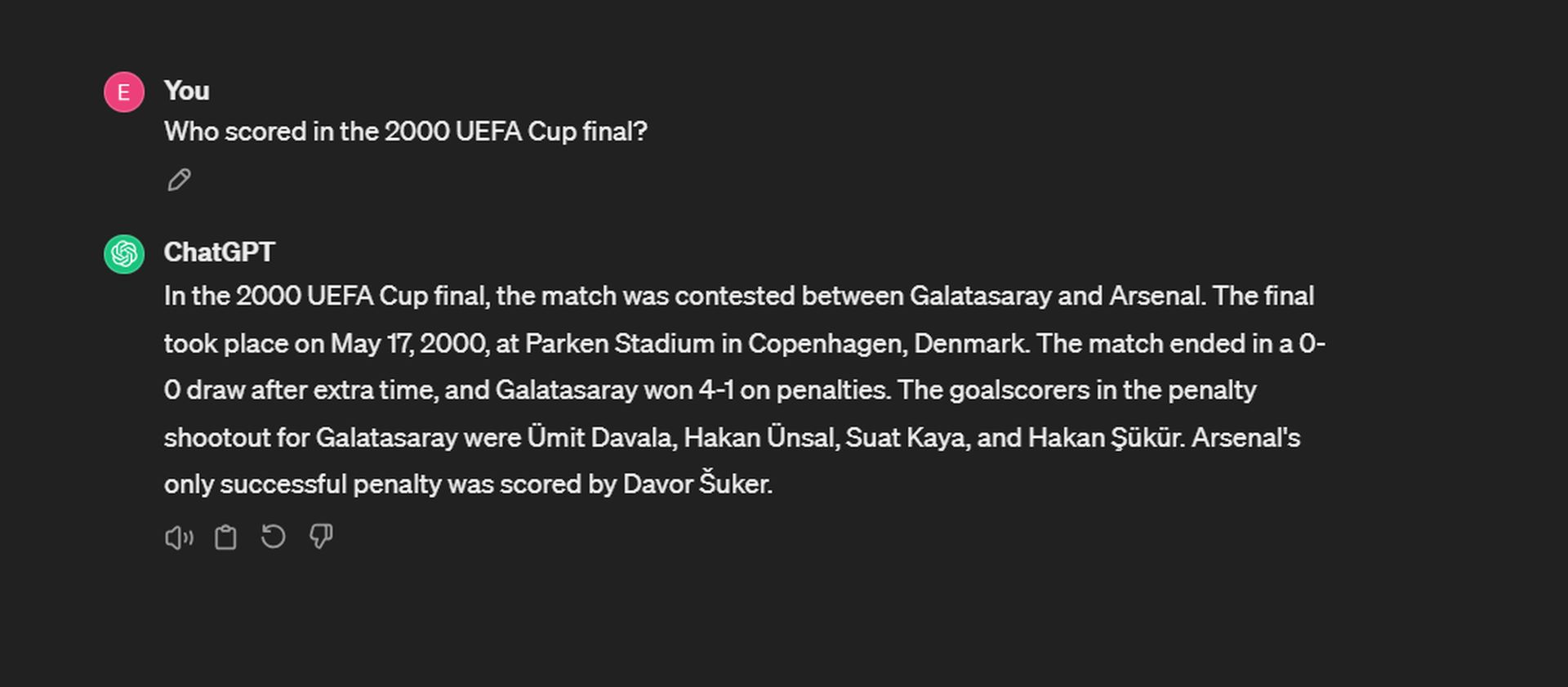

¡O simplemente puedes hacer preguntas y probar suerte! Por ejemplo, intentamos hacer que ChatGPT alucine:

Si bien ChatGPT recuerda con precisión la fecha y el puntaje, falla al recordar a los goleadores de la tanda de penales. Los goles del Galatasaray los marcaron Ergün Penbe, Hakan Şükür, Ümit Davala y Popescu. Por parte del Arsenal, Ray Parlor fue el único autor acertado de penalti.

Si bien hacer que la IA alucine puede ayudarnos a comprender sus limitaciones, es importante utilizar este conocimiento de manera responsable y garantizar que los sistemas de IA sigan siendo confiables y dignos de confianza.

¿GPT 4 alucina menos?

Sí, según el evaluación realizado por la empresa con sede en Palo Alto utilizando su modelo de evaluación de alucinaciones, GPT-4 demuestra una tasa de alucinaciones más baja en comparación con otros modelos de lenguaje grandes, excepto Intel Neural Chat 7B (97.2%). Con una tasa de precisión del 97% y una tasa de alucinaciones del 3%, GPT-4 exhibe un alto nivel de precisión y una tendencia relativamente baja a introducir alucinaciones al resumir documentos. Esto indica que GPT-4 es menos propenso a generar resultados incorrectos o sin sentido en comparación con otros modelos probados en la evaluación.

Por otro lado, pocos de los modelos menos efectivos provinieron de Google. Google Palm 2 demostró una tasa de precisión del 90% y una tasa de alucinaciones del 10%. Su contraparte refinada por chat tuvo un desempeño aún peor, con una tasa de precisión de solo el 84.2 % y la puntuación de alucinaciones más alta de cualquier modelo en la clasificación con un 16.2 %. Aquí está la lista:

En resumen, una alucinación de IA es un error cometido por los sistemas de IA cuando producen resultados que no tienen sentido o son incorrectos debido a fallas en los datos de entrenamiento o en la forma en que procesan la información. Es un aspecto fascinante, pero desafiante, de la IA que los investigadores y desarrolladores están trabajando para abordar.

- Distribución de relaciones públicas y contenido potenciado por SEO. Consiga amplificado hoy.

- PlatoData.Network Vertical Generativo Ai. Empodérate. Accede Aquí.

- PlatoAiStream. Inteligencia Web3. Conocimiento amplificado. Accede Aquí.

- PlatoESG. Carbón, tecnología limpia, Energía, Ambiente, Solar, Gestión de residuos. Accede Aquí.

- PlatoSalud. Inteligencia en Biotecnología y Ensayos Clínicos. Accede Aquí.

- Fuente: https://dataconomy.com/2024/04/11/what-exactly-is-an-ai-hallucination-and-why-does-it-matter/