Pawel Malinowski, director de programas de imec, se sentó con Semiconductor Engineering para analizar qué está cambiando en la tecnología de sensores y por qué. Lo que sigue son extractos de esa discusión.

SE: ¿Qué sigue para la tecnología de sensores?

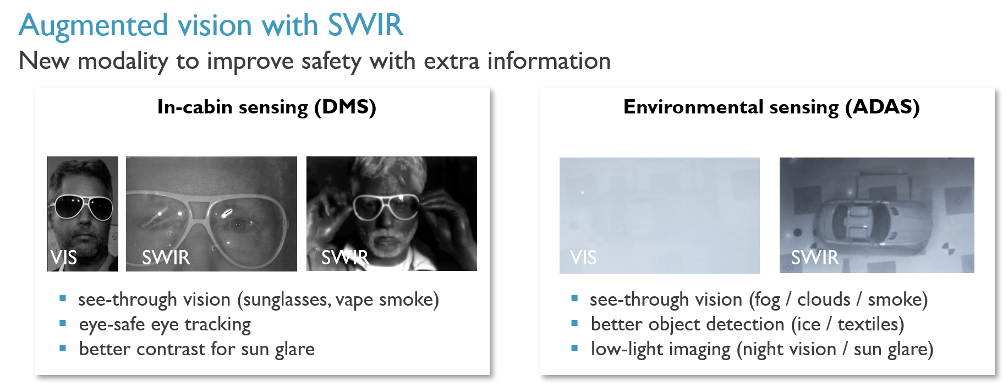

malinowski: Estamos intentando encontrar una nueva forma de fabricar sensores de imagen porque queremos salir de las limitaciones de  Fotodiodos de silicio. El silicio es un material perfecto, especialmente si quieres reproducir la visión humana porque es sensible a las longitudes de onda visibles de la luz, lo que significa que puedes hacer lo que hace el ojo humano. Y el campo ahora se encuentra en una etapa en la que es muy maduro. Se venden alrededor de 6 mil millones de sensores de imagen al año. Estos son los chips que acaban en las cámaras de los smartphones, los coches y otras aplicaciones. Son sensores de imagen estándar típicos, donde se encuentran los circuitos basados en silicio o la electrónica y el fotodiodo de silicio. Básicamente hacen la reproducción de rojo/verde/azul (RGB) para que podamos tener buenas fotografías. Pero si observamos otras longitudes de onda (por ejemplo, la ultravioleta o la infrarroja), obtenemos fenómenos o información que no podemos obtener con la luz visible. Nos fijamos especialmente en el rango de infrarrojos. Allí abordamos un rango específico, que está entre una micra y dos micras, al que llamamos infrarrojo de onda corta. Con este rango puedes ver a través de las cosas. Por ejemplo, puedes ver a través de la niebla, el humo o las nubes. Esto es especialmente interesante para aplicaciones de automoción.

Fotodiodos de silicio. El silicio es un material perfecto, especialmente si quieres reproducir la visión humana porque es sensible a las longitudes de onda visibles de la luz, lo que significa que puedes hacer lo que hace el ojo humano. Y el campo ahora se encuentra en una etapa en la que es muy maduro. Se venden alrededor de 6 mil millones de sensores de imagen al año. Estos son los chips que acaban en las cámaras de los smartphones, los coches y otras aplicaciones. Son sensores de imagen estándar típicos, donde se encuentran los circuitos basados en silicio o la electrónica y el fotodiodo de silicio. Básicamente hacen la reproducción de rojo/verde/azul (RGB) para que podamos tener buenas fotografías. Pero si observamos otras longitudes de onda (por ejemplo, la ultravioleta o la infrarroja), obtenemos fenómenos o información que no podemos obtener con la luz visible. Nos fijamos especialmente en el rango de infrarrojos. Allí abordamos un rango específico, que está entre una micra y dos micras, al que llamamos infrarrojo de onda corta. Con este rango puedes ver a través de las cosas. Por ejemplo, puedes ver a través de la niebla, el humo o las nubes. Esto es especialmente interesante para aplicaciones de automoción.

SE: ¿Algún próximo desafío o nuevas aplicaciones para esta tecnología?

malinowski: No se puede utilizar silicio para esta longitud de onda porque se vuelve transparente. Esto es interesante, por ejemplo, para la inspección de defectos cuando se observan grietas en células solares de silicio. Tienes diferentes contrastes de algunos materiales. Los materiales que parecen exactamente iguales en el rango visible pueden tener diferente reflectividad en el infrarrojo de onda corta, lo que significa que puedes tener un mejor contraste, por ejemplo, cuando clasificas plásticos o cuando clasificas alimentos. Existen otras aplicaciones, como se muestra en la figura 1 (a continuación). Es el poder de la luz que proviene del sol a través de la atmósfera. El gris está por encima de la atmósfera y el blanco es lo que llega a la tierra. Y ves que hay algunos máximos y mínimos. Los mínimos están relacionados con la absorción de agua en la atmósfera. Puedes utilizar estos mínimos cuando estés trabajando, por ejemplo, con sistemas de eliminación activa, lo que significa que emites algo de luz y compruebas qué está rebotando. Así es como funciona el Face ID en el iPhone: emites luz y compruebas lo que regresa. Operan alrededor de 940 nanómetros. Si optó por longitudes de onda más largas (por ejemplo, 1,400), tendrá un fondo mucho más bajo, lo que significa que podrá tener un contraste mucho mejor. Si luego opta por longitudes de onda en las que todavía hay bastante luz, puede usarla con iluminación pasiva para obtener información adicional, como imágenes con poca luz, donde todavía tiene algunos fotones.

Fig. 1: Las posibilidades del infrarrojo de longitud de onda corta. Fuente: imec

SE: ¿Cómo determinaste eso?

malinowski: Lo que comprobamos es cómo acceder a estas longitudes de onda. El silicio, por sus propiedades físicas, no sirve para eso. La forma tradicional es la unión, en la que se toma otro material (por ejemplo, arseniuro de indio, galio o telururo de mercurio y cadmio) y se une al circuito de lectura. Esta es la tecnología establecida. Se utiliza mucho para aplicaciones de defensa, militares e industriales o científicas de alto nivel. Es caro. Los sensores fabricados con esta tecnología suelen costar unos miles de euros, debido al proceso de unión y a los costes de fabricación. Puedes cultivar el material que necesitas, como el germanio, pero esto es bastante difícil y existen algunos problemas para lograr que el ruido sea lo suficientemente bajo. Estamos siguiendo la tercera vía, que es depositar material. En este caso utilizamos materiales orgánicos o puntos cuánticos. Tomamos material que puede absorber esta luz infrarroja de onda corta o infrarroja cercana, y lo depositamos con métodos estándar, como el recubrimiento por giro, y obtenemos capas muy delgadas. Por eso llamamos a esta categoría de sensores “sensores fotodetectores de película delgada”, donde el material es mucho más absorbente que el silicio. Parece un panqueque encima del circuito de lectura.

SE: ¿Cómo se compara esto con otros materiales?

malinowski: Si lo comparas con los diodos de silicio, necesitan un volumen mucho mayor y una profundidad mucho mayor. Y especialmente para estas longitudes de onda más largas, simplemente se vuelven transparentes. Por el contrario, los sensores de imagen de fotodetectores de película delgada (TFPD) tienen una pila de materiales, incluidos materiales fotoactivos como materiales orgánicos de puntos cuánticos, integrados monolíticamente, lo que significa que es un solo chip. No hay unión encima del silicio. El problema con este enfoque fue que cuando se tiene un fotodiodo de este tipo integrado encima de este electrodo de metal, es muy difícil lograr que el ruido sea lo suficientemente bajo porque hay algunas fuentes de ruido inherentes de las que no es posible deshacerse.

Fig. 2: Fotodetector de película delgada. Fuente: imec

SE: ¿Cómo resolviste esto?

malinowski: Seguimos el camino que progresaron los sensores de imagen de silicio a finales de los años 1980 y en los años 1990, cuando introdujeron fotodiodos fijados. Desacopla el área del fotodiodo donde se convierten los fotones y la lectura. En lugar de tener un solo contacto de este absorbente de película delgada en la lectura, introducimos un transistor adicional. Se trata del TFT, que se encarga de tener la estructura totalmente agotada para que podamos transferir todas las cargas creadas en este absorbente de película delgada y transferirlas con esta estructura de transistor a la lectura. De esta manera limitamos significativamente las fuentes de ruido.

SE: ¿Por qué el ruido es un problema para el diseño de sensores?

malinowski: Existen diferentes fuentes de ruido. El ruido puede ser el número total de electrones no deseados, pero estos electrones pueden provenir de diferentes fuentes o por diferentes motivos. Algunos están relacionados con la temperatura, otros con la falta de uniformidad en el chip, otros con fugas del transistor, etc. Con este enfoque, estamos trabajando en algunas de las fuentes de ruido relacionadas con la lectura. Para todos los sensores de imagen, tienes ruido, pero tienes diferentes formas de lidiar con el ruido. Por ejemplo, los sensores basados en silicio del iPhone tratan fuentes de ruido con un diseño específico del circuito de lectura, con arquitecturas cuya base se remonta a los años 80 y 90. Esto es un poco de lo que intentamos replicar con esta nueva categoría de sensores de imagen que utilizan fotodetectores de campo delgado. Es una aplicación de viejos trucos de diseño en una nueva categoría de sensores.

SE: ¿Dónde cree que se utilizaría esto? Mencionaste la automoción. ¿Funcionaría también para dispositivos médicos?

malinowski: El mayor atractivo para esta tecnología proviene de la electrónica de consumo, como los teléfonos inteligentes. Si utiliza longitudes de onda más largas, puede tener un contraste menor, porque simplemente hay menos luz en esa longitud de onda, o puede ver esta luz de ese color en la atmósfera. Es visión aumentada, lo que significa ver más de lo que el ojo humano puede ver, por lo que hay información adicional para tu cámara. La otra razón es que las longitudes de onda más largas son más fáciles de transmitir a través de algunas pantallas. La promesa es que si tienes este tipo de solución, puedes colocar el sensor, como Face ID, detrás de la otra pantalla, lo que puede aumentar el área de visualización.

Fig. 3: Visión aumentada para una mayor seguridad. Fuente: imec

La otra razón es que si utiliza longitudes de onda más largas, su ojo es mucho menos sensible: alrededor de cinco o seis órdenes de magnitud en comparación con las longitudes de onda del infrarrojo cercano, lo que significa que puede utilizar fuentes de luz más potentes. Entonces puedes disparar más potencia, lo que significa que puedes tener alcances más largos. En el caso del automóvil, puede tener visibilidad adicional, especialmente en condiciones climáticas adversas, como visibilidad a través de la niebla. En el ámbito médico, podría ayudar a avanzar en la miniaturización. En algunas aplicaciones, como la endoscopia, la tecnología actual utiliza otros materiales y una integración más compleja, por lo que la miniaturización es bastante difícil. Con un enfoque de puntos cuánticos, se pueden crear píxeles muy pequeños, lo que significa una resolución más alta en un factor de forma compacto. Esto permite una mayor miniaturización manteniendo una alta resolución. Además, dependiendo de la longitud de onda que apuntemos, podemos tener un contraste de agua muy alto, que es una de las razones por las que la industria alimentaria podría estar interesada. Se puede detectar mejor la humedad, por ejemplo, en productos de cereales como los cereales.

Fig. 4: Aplicaciones potenciales Fuente: imec

SE: Con el aumento de la visión en condiciones de poca luz, ¿podría tener aplicaciones militares?

malinowski: Este tipo de sensores ya los utilizan los militares, por ejemplo, para detectar telémetros láser. La diferencia es que a los militares les parece bien pagar 20,000 euros por una cámara. En automoción o consumo ni siquiera se plantean esta tecnología, precisamente por eso.

SE: Entonces, ¿el gran avance aquí es que se puede tener algo que ya existe, pero a un precio a escala del consumidor?

malinowski: Exactamente. Debido a la miniaturización y también a cómo la integración monolítica permite mejorar la tecnología, se pueden obtener volúmenes y precios a escala de consumidor.

SE: ¿Qué otras tendencias ve en la tecnología de sensores?

malinowski: Uno de los puntos de discusión actuales es exactamente este: más allá de las imágenes visibles. La tecnología actual ya es fantástica para tomar fotografías. La nueva tendencia son los sensores más dedicados a la aplicación. No es necesario que el resultado sea una imagen bonita. Puede ser información específica. Con Face ID, la salida puede ser realmente uno o cero. O el teléfono está desbloqueado o no. No es necesario que veas la imagen de la cara. También están surgiendo algunas modalidades interesantes, como las cámaras polarizadas, que son como gafas polarizadas. Ven mejor por algunos reflejos. Hay generadores de imágenes basados en eventos, que sólo observan el cambio de escena, por ejemplo, si se estudian las vibraciones de una máquina o se cuentan las personas que pasan por una tienda. Si tiene un sistema de conducción autónomo, necesita una advertencia de que se avecina un obstáculo y debe frenar. No necesitas una imagen bonita. Esta tendencia significa mucha más fragmentación, porque es mucho más específica de la aplicación. Cambia la forma en que las personas diseñan sensores de imagen porque miran lo que es lo suficientemente bueno para una aplicación particular en lugar de optimizar la calidad de la imagen. La calidad de la imagen siempre es importante, pero a veces necesitas algo simple que simplemente haga el trabajo.

SE: ¿Es importante saber si es un ser humano o un árbol, o basta con saber que hay que frenar ahora?

malinowski: En la industria del automóvil todavía hay debate. Algunas personas quieren clasificar todos los objetos. Quieren saber si es un niño, un ciclista o un árbol. Algunos dicen: “Sólo necesito saber si está en el camino, porque necesito accionar los frenos”. Así que no hay una sola respuesta.

- Distribución de relaciones públicas y contenido potenciado por SEO. Consiga amplificado hoy.

- PlatoData.Network Vertical Generativo Ai. Empodérate. Accede Aquí.

- PlatoAiStream. Inteligencia Web3. Conocimiento amplificado. Accede Aquí.

- PlatoESG. Carbón, tecnología limpia, Energía, Ambiente, Solar, Gestión de residuos. Accede Aquí.

- PlatoSalud. Inteligencia en Biotecnología y Ensayos Clínicos. Accede Aquí.

- Fuente: https://semiengineering.com/a-new-approach-for-sensor-design/