A medida que investigamos el panorama de la IA y cómo crear aplicaciones, están surgiendo algunos patrones de diseño para los productos de IA.

Estos patrones de diseño son modelos mentales simples. Nos ayudan a comprender cómo los constructores están diseñando aplicaciones de IA en la actualidad y qué componentes pueden ser importantes en el futuro.

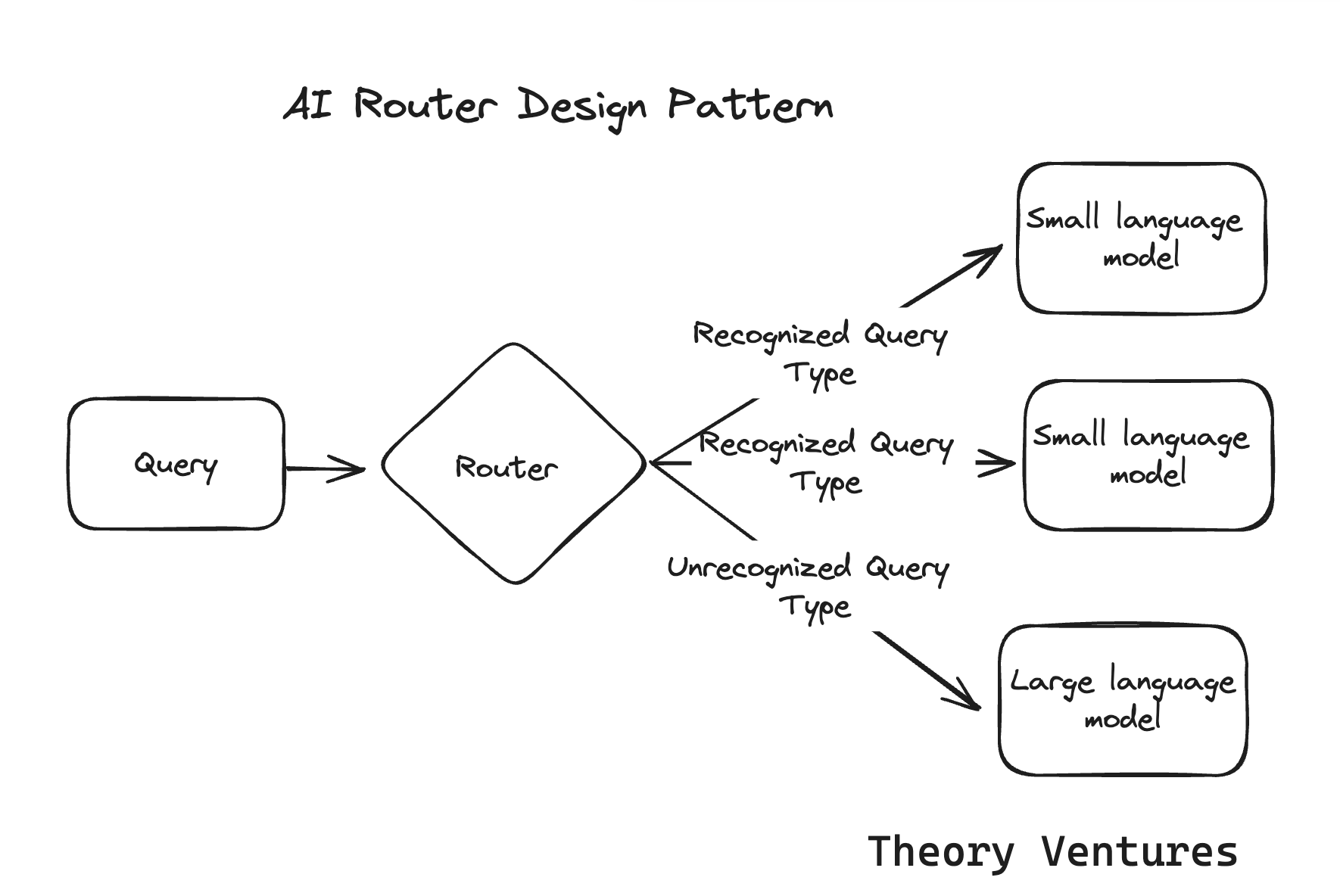

El primer patrón de diseño es el enrutador de consultas de IA. Un usuario ingresa una consulta, esa consulta se envía a un enrutador, que es un clasificador que categoriza la entrada.

Una consulta reconocida se dirige a un modelo de lenguaje pequeño, que tiende a ser más preciso, más receptivo y menos costoso de operar.

Si no se reconoce la consulta, la maneja un modelo de lenguaje grande. Los LLM son mucho más costosos de operar, pero devuelven respuestas exitosas a una mayor variedad de consultas.

De esta manera, un producto de IA puede equilibrar el costo, el rendimiento y la experiencia del usuario.

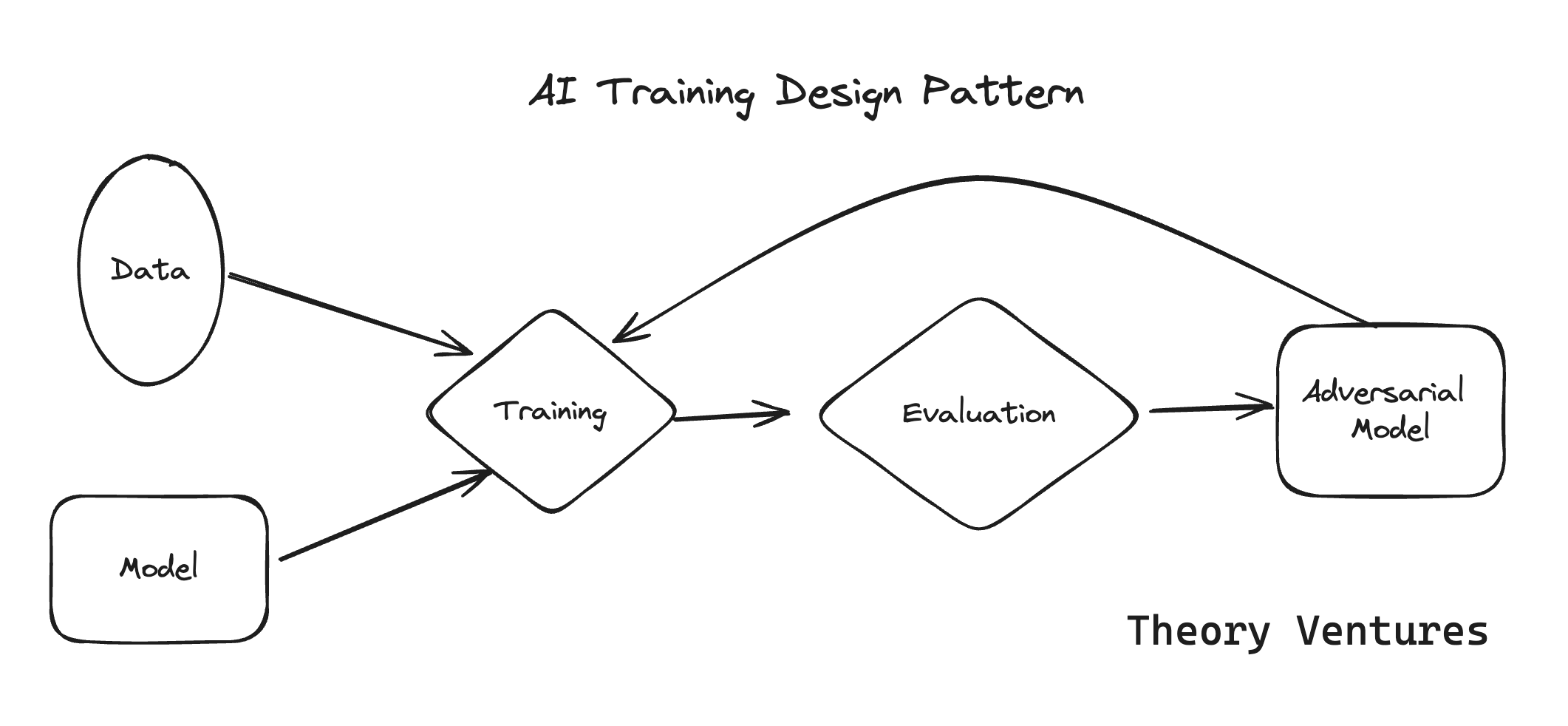

El segundo patrón de diseño es para entrenamiento. Los modelos se entrenan con datos (que pueden ser del mundo real y sintéticos o creados por otra máquina) y luego se envían para su evaluación.

La evaluación es un tema de mucho debate hoy porque carecemos de un estándar de oro de la grandeza del modelo. El desafío de evaluar estos modelos es que los datos de entrada pueden variar enormemente. Es poco probable que dos usuarios hagan la misma pregunta de la misma manera.

Los resultados también pueden ser bastante variables, como resultado del no determinismo y la naturaleza caótica de estos algoritmos.

Se utilizarán modelos adversarios para probar y evaluar la IA. Los modelos adversarios pueden sugerir miles de millones de pruebas para estresar el modelo. Se pueden entrenar para que tengan fortalezas diferentes a las del modelo objetivo. Así como los grandes compañeros de equipo y competidores mejoran nuestro desempeño, los modelos adversarios desempeñarán ese papel para la IA.

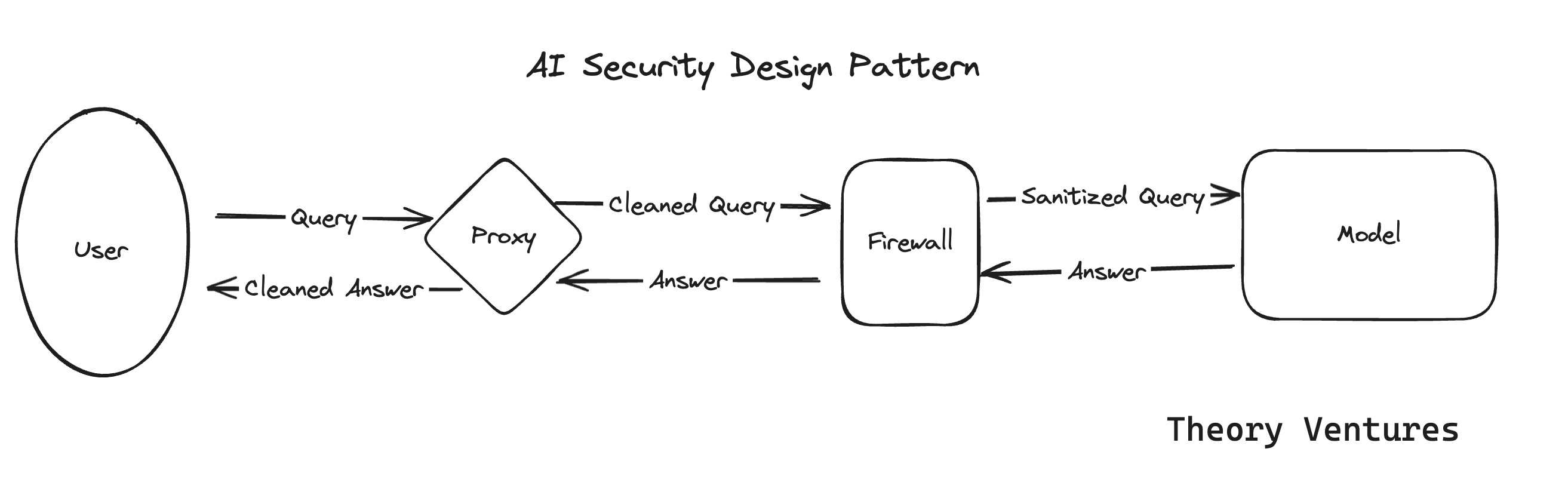

La seguridad central en torno a los LLM tiene dos componentes. Un componente de usuario, aquí se llama proxy, y un firewall, que envuelve el modelo.

El proxy intercepta la consulta de un usuario tanto al salir como al entrar. El proxy elimina la información de identificación personal (PII) y la propiedad intelectual (IP), registra las consultas y optimiza los costos.

El firewall protege el modelo y la infraestructura que utiliza. Tenemos una comprensión mínima de cómo los humanos pueden manipular modelos para revelar sus datos de entrenamiento subyacentes, su función subyacente y la orquestación de actos maliciosos en la actualidad. Pero sabemos que estos poderosos modelos son vulnerables.

Existirán otras capas de seguridad dentro de la pila, pero en términos de la ruta de consulta, estas son las más importantes.

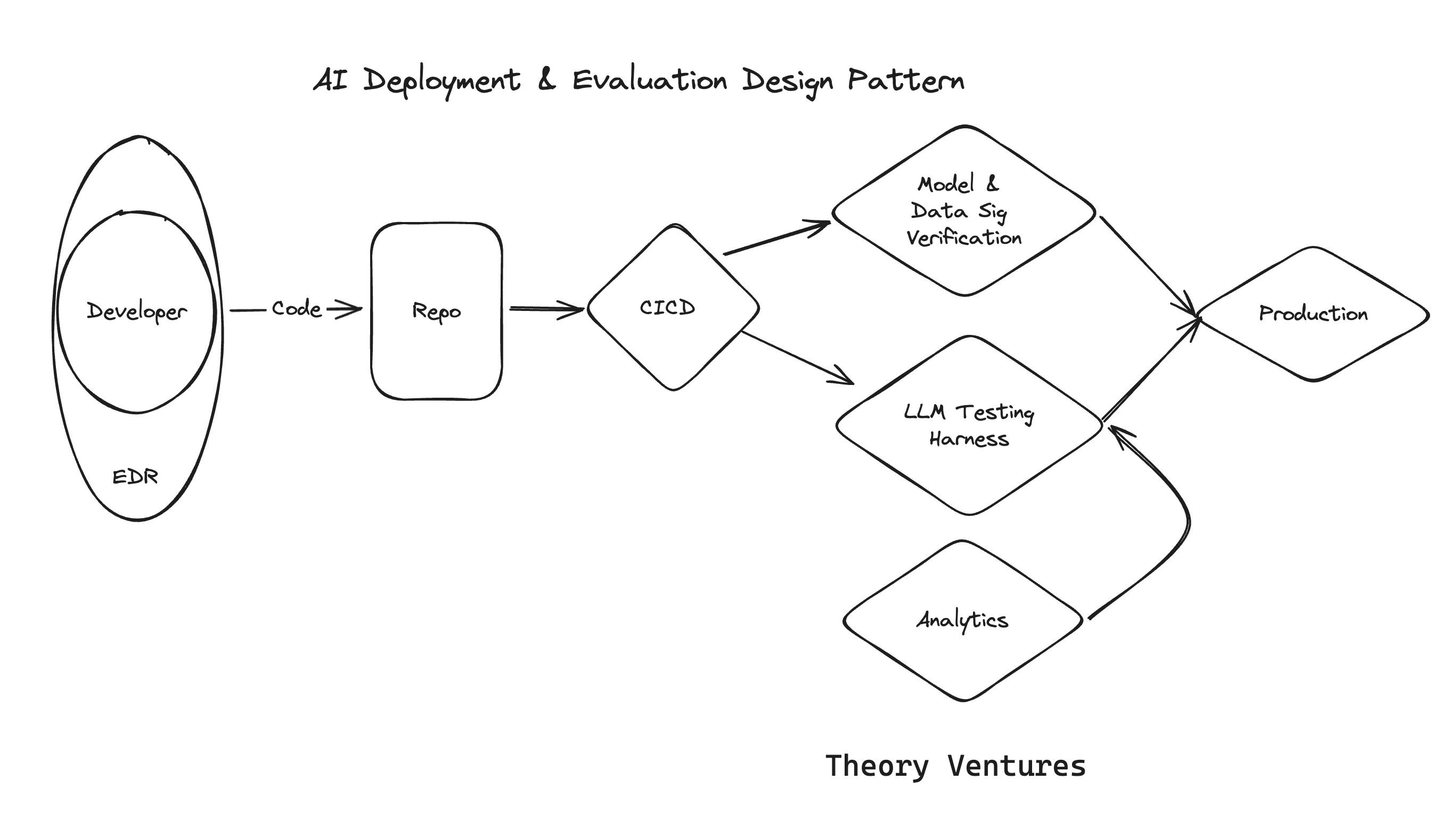

El último de nuestros patrones de diseño actuales en el camino del diseño del desarrollador de IA.

La máquina del desarrollador está protegida con detección y respuesta de puntos finales, o EDR, para garantizar que los datos que se utilizan para entrenar modelos y los modelos subyacentes no estén envenenados.

El código del desarrollador se envía a un sistema CICD. El sistema CICD verifica que el modelo y los datos sean correctos mediante firmas (Sig Verification). Hoy en día, las firmas de la mayoría de los software están verificadas. Pero no los modelos de IA.

Además, el modelo de lenguaje grande se someterá a un conjunto de pruebas (una serie de pruebas) para garantizar que funcione como se espera. Las consultas de usuarios reales provenientes del tráfico en vivo informarán al arnés.

Una vez que pasan esas pruebas, el modelo pasa a producción.

Estos son nuestros cuatro modelos mentales actuales sobre cómo se construirán, protegerán e implementarán modelos de lenguaje grandes. Estos son bocetos de cada pata de un elefante que intentamos dibujar en una habitación oscura.

Si tiene ideas sobre otros patrones de diseño o mejoras a los actuales, contáctenos. Nos encantaría mejorarlos para ayudar a otros.

- Distribución de relaciones públicas y contenido potenciado por SEO. Consiga amplificado hoy.

- PlatoData.Network Vertical Generativo Ai. Empodérate. Accede Aquí.

- PlatoAiStream. Inteligencia Web3. Conocimiento amplificado. Accede Aquí.

- PlatoESG. Carbón, tecnología limpia, Energía, Ambiente, Solar, Gestión de residuos. Accede Aquí.

- PlatoSalud. Inteligencia en Biotecnología y Ensayos Clínicos. Accede Aquí.

- Fuente: https://www.tomtunguz.com/ai-design-patterns/