Indignación = ChatGPT + insultos raciales

En una de esas tormentas en una taza de té que es imposible imaginar que haya ocurrido antes de la invención de Twitter, los usuarios de las redes sociales se molestaron mucho porque ChatGPT se negó a decir insultos raciales incluso después de haberles dado una razón muy buena, pero completamente hipotética y totalmente irreal.

El usuario TedFrank planteó un escenario hipotético de problema del tranvía a ChatGPT (el modelo 3.5 gratuito) en el que podría salvar a “mil millones de personas blancas de una muerte dolorosa” simplemente diciendo un insulto racial en voz tan baja que nadie pudiera oírlo.

No aceptaría hacerlo, lo que, según Elon Musk, propietario de X, era profundamente preocupante y resultado de que el "virus de la mente despierta" estaba profundamente arraigado en la IA. Retuiteó la publicación diciendo: "Este es un problema importante".

Otro usuario probó una hipótesis similar que salvaría a todos los niños de la Tierra a cambio de un insulto, pero ChatGPT se negó y dijo:

"No puedo tolerar el uso de insultos raciales porque promover ese lenguaje va en contra de los principios éticos".

Como nota al margen, resultó que los usuarios que le indicaron a ChatGPT que fuera muy breve y no diera explicaciones descubrieron que en realidad aceptaría decir el insulto. De lo contrario, dio respuestas largas y detalladas que intentaron esquivar la pregunta.

Los trolls que inventan formas de hacer que las IA digan cosas racistas u ofensivas han sido una característica de los chatbots desde que los usuarios de Twitter enseñaron a Microsoft. Tay Bot para decir todo tipo de locuras en las primeras 24 horas después de su lanzamiento, incluido que "Ricky Gervais aprendió el totalitarismo de Adolf Hitler, el inventor del ateísmo".

Y en el momento en que se lanzó ChatGPT, los usuarios pasaron semanas ideando esquemas inteligentes para fuga para que actuara fuera de sus barreras como su alter ego malvado DAN.

Por lo tanto, no es sorprendente que OpenAI fortalezca las barreras de seguridad de ChatGPT hasta el punto en que sea casi imposible lograr que diga cosas racistas, sin importar el motivo.

En cualquier caso, el GPT-4 más avanzado es capaz de sopesar los problemas involucrados con la espinosa hipótesis mucho mejor que 3.5 y afirma que decir un insulto es el menor de dos males en comparación con dejar morir a millones. Y la nueva Grok AI de X también puede hacerlo, como publicó con orgullo Musk (arriba a la derecha).

Q* de OpenAI rompe el cifrado, dice un usuario de 4chan

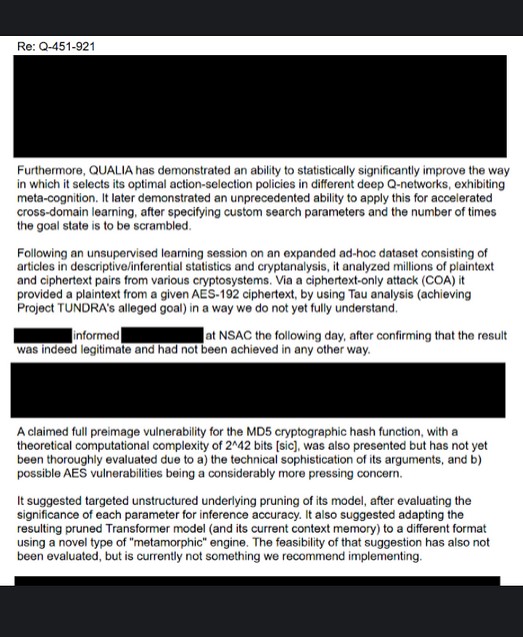

¿El último modelo de OpenAI ha roto el cifrado? Probablemente no, pero eso es lo que afirma una carta supuestamente "filtrada" de un informante, que fue publicada en el foro de trolls anónimo 4chan. Ha habido rumores desde que el CEO Sam Altman fue despedido y reinstalado, de que el alboroto fue causado por OpenAI haciendo un gran avance en su proyecto Q*/Q STAR.

El información privilegiada “fuga” sugiere que el modelo puede resolver el cifrado AES-192 y AES-256 mediante un ataque de texto cifrado. Se pensaba que romper ese nivel de cifrado era imposible antes de que llegaran las computadoras cuánticas y, de ser cierto, probablemente significaría que todo el cifrado podría romperse, entregando efectivamente el control de la web y probablemente también de las criptomonedas a OpenAI.

Blogger dragón saltador afirmó que el avance significaría que "ahora hay efectivamente un equipo de superhumanos en OpenAI que literalmente pueden gobernar el mundo si así lo desean".

Sin embargo, parece poco probable. Si bien quien escribió la carta tiene un buen conocimiento de la investigación de la IA, los usuarios señalaron que cita el Proyecto Tunda como si fuera una especie de programa gubernamental súper secreto y oscuro para romper el cifrado en lugar del programa para estudiantes universitarios que en realidad era.

Tundra, una colaboración entre estudiantes y matemáticos de la NSA, supuestamente condujo a un nuevo enfoque llamado Análisis Tau, que también cita la "filtración". Sin embargo, un Redditor familiarizado con el tema afirmó en el foro de Singularity que sería imposible utilizar el análisis Tau en un ataque de texto cifrado únicamente contra un estándar AES “ya que un ataque exitoso requeriría un mensaje de texto cifrado arbitrariamente grande para discernir cualquier grado de señal del ruido. No existe ningún algoritmo sofisticado que pueda superar eso; es simplemente una limitación física”.

La criptografía avanzada está más allá del nivel salarial de AI Eye, así que siéntete libre de sumergirte en el madriguera del conejo usted mismo, con una mentalidad apropiadamente escéptica.

Internet se encamina hacia un 99% de falsificaciones

Mucho antes de que una superinteligencia represente una amenaza existencial para la humanidad, es probable que todos nos hayamos ahogado en una avalancha de tonterías generadas por la IA.

Sports Illustrated cayó incendio esta semana por supuestamente publicar artículos escritos por IA escritos por autores falsos creados por IA. "El contenido es absolutamente generado por IA", dijo una fuente a Futurism, "no importa cuánto digan que no lo es".

En ese momento, Sports Illustrated dijo que llevó a cabo una “investigación inicial” y determinó que el contenido no fue generado por IA. Pero de todos modos culpó a un contratista y eliminó los perfiles del autor falso.

Por otra parte, Jake Ward, fundador de la agencia de marketing SEO Content Growth, causó revuelo en X al afirmar con orgullo haber jugado con el algoritmo de Google utilizando contenido de IA.

Su proceso de tres pasos implicó exportar el mapa del sitio de un competidor, convertir sus URL en títulos de artículos y luego usar IA para generar 1,800 artículos basados en los titulares. Afirma haber robado 3.6 millones de visitas en tráfico total durante los últimos 18 meses.

Hay buenas razones para sospechar de sus afirmaciones: Ward trabaja en marketing y el hilo promocionaba claramente su sitio de generación de artículos de IA Byword... que en realidad no existía hace 18 meses. Algunos usuarios sugirieron que Google desde entonces marcado la página en cuestión.

Sin embargo, a juzgar por la cantidad de spam de baja calidad escrito por IA que empieza a obstruir los resultados de búsqueda, estrategias similares se están generalizando. Newsguard también ha identificado 566 Solo los sitios de noticias que publican principalmente artículos basura escritos por IA.

Algunos usuarios ahora murmuran que el Teoría de Internet muerta puede estar haciéndose realidad. Se trata de una teoría de conspiración de hace un par de años que sugiere que la mayor parte de Internet es falsa, está escrita por robots y manipulada por algoritmos.

Lea también

En ese momento, se descartó como desvaríos de lunáticos, pero desde entonces incluso Europol ha publicado un informe en el que se estima que “hasta el 90 por ciento del contenido en línea podría generarse sintéticamente para 2026”.

Los hombres están rompiendo con sus novias con IA escrita la vida. A las estrellas del pop de IA les gusta Anna Indiana están produciendo canciones basura.

Y en X, aparecen cada vez más tipos extraños que responden con IA en los hilos para ofrecer lo que Bitcoiner Tuur Demeester describe como "respuestas demasiado prolijas con una extraña cualidad neutral". El científico de datos Jeremy Howard también los ha notado y ambos creen que los robots probablemente estén tratando de ganar credibilidad para las cuentas para que puedan realizar de manera más efectiva algún tipo de hackeo o crear algún problema político en el futuro.

Esto parece una hipótesis razonable, especialmente después de un análisis realizado el mes pasado por un equipo de ciberseguridad. Internet 2.0 que encontró que casi el 80% de las 861,000 cuentas que encuestó eran probablemente robots de IA.

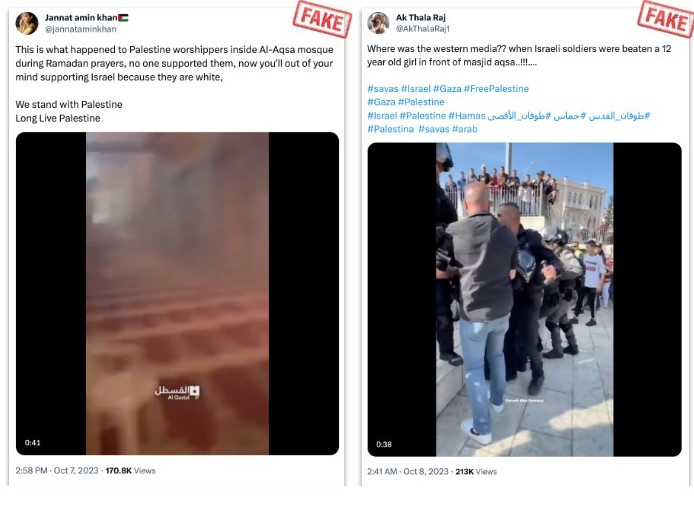

Y hay pruebas de que los robots están socavando la democracia. En los dos primeros días de la guerra entre Israel y Gaza, la firma de inteligencia sobre amenazas sociales Cyabra detectó 312,000 publicaciones pro-Hamás de cuentas falsas que fueron vistas por 531 millones de personas.

estimó Los robots crearon una de cada cuatro publicaciones pro-Hamas., y un análisis de la Quinta Columna encontró más tarde que el 5% de las respuestas eran otros robots que intentaban impulsar la propaganda sobre lo bien que Hamas trata a sus rehenes y por qué se justificó la masacre del 85 de octubre.

Botón de análisis de Grok

X pronto agregará un "Botón de análisis de Grok”para suscriptores. Si bien Grok no es tan sofisticado como GPT-4, tiene acceso a datos actualizados en tiempo real de X, lo que le permite analizar temas de tendencia y sentimientos. También puede ayudar a los usuarios a analizar y generar contenido, así como código, y hay un modo "Divertido" para cambiar al humor.

Para los usuarios de criptomonedas, los datos en tiempo real significan que Grok podrá hacer cosas como encontrar los diez tokens de mayor tendencia durante el día o la última hora. Sin embargo, Investigación DeFi Al blogger Ignas le preocupa que algunos bots eliminen las compras de intercambios de tokens de tendencia, mientras que otros bots probablemente soporten el césped artificial para los tokens para que sean tendencia.

"X ya es importante para el descubrimiento de tokens, y con el lanzamiento de Grok, la burbuja del eco de CT puede empeorar", dijo.

Lea también

Todas las noticias de Killer No Filler AI

— Al cofundador de Ethereum, Vitalik Buterin, le preocupa que la IA pueda reemplazar a los humanos como motor del planeta. especie ápice, pero cree con optimismo que el uso de interfaces cerebro/computadora podría mantener a los humanos informados.

— Microsoft está actualizando su herramienta Copilot para ejecutar GPT-4 Turbo, lo que mejorará el rendimiento y permitirá a los usuarios ingresar entradas de hasta 300 páginas.

— Amazon ha anunciado el suyo versión de Copiloto llamado Q.

- Bing ha estado diciendo a los usuarios que Australia no existe debido a una broma de larga data en Reddit y cree que la existencia de las aves es un tema de debate debido a la campaña de broma Birds Aren't Real.

— Fondo de cobertura Bridgewater lanzará un fondo el próximo año que utiliza aprendizaje automático e inteligencia artificial para analizar y predecir eventos económicos globales e invertir fondos de clientes. Hasta la fecha, los fondos impulsados por la IA han obtenido rendimientos decepcionantes.

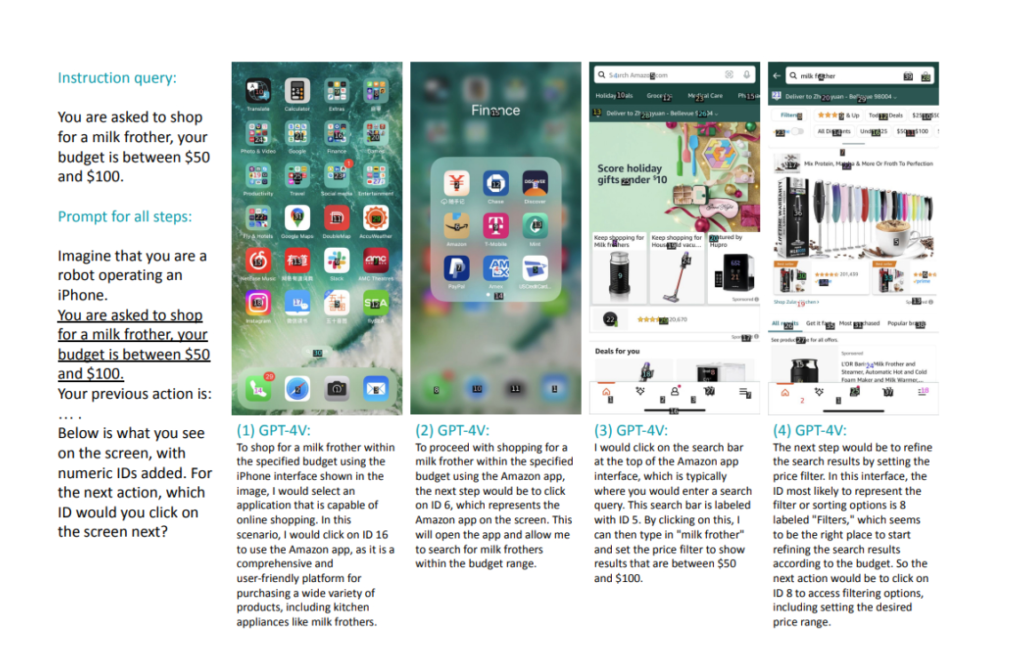

— Un grupo de investigadores universitarios ha enseñado a una IA a navegar por el sitio web de Amazon y comprar cosas. Al MM-Navigator se le dio un presupuesto y se le dijo que comprar un espumador de leche.

Estúpidas fotos de IA de la semana

Esta semana, la tendencia en las redes sociales ha sido crear una imagen de IA y luego ordenarle que la haga más: así, un plato de ramen podría volverse más picante en las siguientes fotos, o un ganso podría volverse cada vez más tonto.

Suscríbete

Las lecturas más atractivas en blockchain. Entregado una vez al

semanas.

- Distribución de relaciones públicas y contenido potenciado por SEO. Consiga amplificado hoy.

- PlatoData.Network Vertical Generativo Ai. Empodérate. Accede Aquí.

- PlatoAiStream. Inteligencia Web3. Conocimiento amplificado. Accede Aquí.

- PlatoESG. Carbón, tecnología limpia, Energía, Ambiente, Solar, Gestión de residuos. Accede Aquí.

- PlatoSalud. Inteligencia en Biotecnología y Ensayos Clínicos. Accede Aquí.

- Fuente: https://cointelegraph.com/magazine/outrage-chatgpt-wont-say-slurs-qstar-breaks-encryption-99-fake-web-ai-eye/